تحذيرات متصاعدة من أداة “AI Overviews” التابعة لـ”جوجل” بعد تقديم معلومات صحية مضللة

الترند العربي – متابعات

كشفت صحيفة ذا جارديان البريطانية، في تحقيق حديث، أن ملخصات الذكاء الاصطناعي التي تقدمها شركة جوجل قد تعرض حياة المستخدمين للخطر، نتيجة احتوائها على معلومات صحية خاطئة ومضللة.

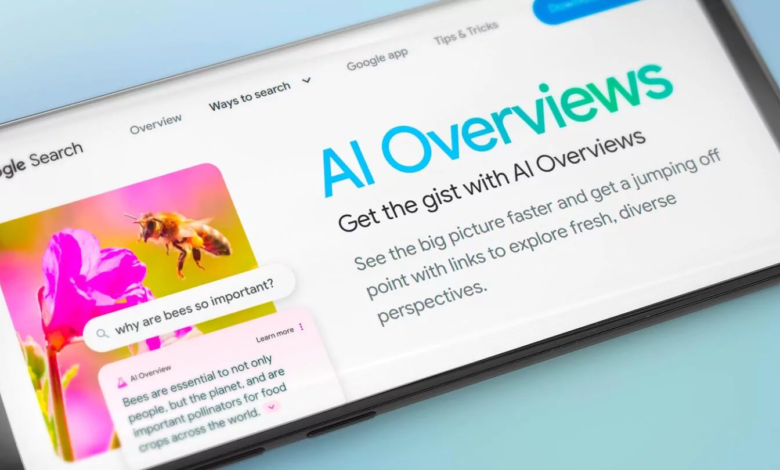

وتعتمد أداة “AI Overviews” على تقنيات الذكاء الاصطناعي التوليدي لتقديم ملخصات سريعة تتصدر نتائج البحث، وتعرض للمستخدمين أهم المعلومات المتعلقة بالأسئلة أو الموضوعات التي يبحثون عنها. ورغم تأكيد جوجل أن الأداة “مفيدة” و“موثوقة”، فإن التحقيق أظهر أن بعض هذه الملخصات تفتقر إلى الدقة، خاصة في القضايا الصحية الحساسة.

وأشار التقرير إلى حالات وصفها خبراء بأنها “شديدة الخطورة”، من بينها نصيحة قدمتها الأداة لمرضى سرطان البنكرياس بتجنب الأطعمة عالية الدهون، وهو ما يتعارض كليًا مع الإرشادات الطبية المعتمدة، وقد يؤدي – بحسب المختصين – إلى زيادة خطر الوفاة.

وفي مثال آخر، وصِف بالمقلق، قدمت أداة جوجل معلومات غير صحيحة حول اختبارات وظائف الكبد الأساسية، ما قد يدفع بعض المرضى المصابين بأمراض كبدية خطيرة إلى الاعتقاد بأن حالتهم الصحية طبيعية، رغم حاجتهم إلى تدخل طبي عاجل.

كما أظهرت نتائج البحث المتعلقة بفحوصات سرطان النساء معلومات “خاطئة تمامًا”، وهو ما قد يؤدي إلى تجاهل أعراض حقيقية، وفقًا لما حذر منه خبراء الصحة.

من جهتها، قالت جوجل إن العديد من الأمثلة التي جرى تداولها كانت مبنية على “لقطات شاشة غير مكتملة”، موضحة أنه وفق تقييمها، فإن الأداة تحيل المستخدمين إلى “مصادر معروفة وموثوقة”، وتوصي دائمًا باستشارة المتخصصين.

ويأتي هذا التحقيق في وقت تتزايد فيه المخاوف من اعتماد المستخدمين المفرط على مخرجات الذكاء الاصطناعي، وافتراضهم أنها دقيقة وموثوقة. ففي نوفمبر من العام الماضي، كشفت دراسة أن روبوتات الدردشة المدعومة بالذكاء الاصطناعي عبر عدة منصات قدمت نصائح مالية غير دقيقة، كما أُثيرت انتقادات مماثلة بشأن ملخصات الأخبار الآلية.

وفي هذا السياق، قالت ستيفاني باركر، مديرة قسم التسويق الرقمي في مؤسسة “ماري كوري” الخيرية المتخصصة في رعاية المرضى في المراحل الأخيرة من حياتهم:

“يلجأ الناس إلى الإنترنت في لحظات القلق والأزمات، وإذا كانت المعلومات التي يحصلون عليها غير دقيقة أو خارجة عن سياقها، فقد يتسبب ذلك في ضرر بالغ لصحتهم”.

وأشار تحقيق ذا غارديان إلى أنه رصد عدة حالات لمعلومات صحية غير دقيقة قدمتها أداة “AI Overviews”، بعد تلقي شكاوى وتحذيرات من جمعيات صحية وخيرية، إضافة إلى مهنيين في القطاع الطبي.

كما توصل التحقيق إلى أن الأداة تقدم نتائج مضللة في عمليات البحث المتعلقة بالصحة النفسية، ما يفاقم المخاوف بشأن تأثيرها على المستخدمين.

وفي ردها، أكدت جوجل أن الغالبية العظمى من ملخصات الذكاء الاصطناعي التي تقدمها واقعية ومفيدة، مشيرة إلى أنها تعمل باستمرار على تحسين جودة الأداة. وأضافت أن معدل دقة “AI Overviews” يماثل ميزات البحث الأخرى لديها، مثل “المقتطفات المميزة” المستخدمة منذ أكثر من عشر سنوات.

وأوضحت الشركة أنها ستتخذ الإجراءات اللازمة وفق سياساتها المعتمدة في حال أساءت الأداة تفسير محتوى الويب أو أغفلت السياق الصحيح للمعلومات.

وقال متحدث باسم جوجل: “نستثمر بشكل كبير في تحسين جودة AI Overviews، لا سيما في الموضوعات الحساسة مثل الصحة، ومعظم هذه الملخصات تقدم معلومات دقيقة”.

س: ما هي أداة “AI Overviews”؟

ج: هي أداة تعتمد على الذكاء الاصطناعي التوليدي لتقديم ملخصات سريعة حول موضوع أو سؤال معين، وتظهر عادة في أعلى نتائج البحث.

س: لماذا أثارت الأداة المخاوف؟

ج: لأن بعض الملخصات قدمت معلومات صحية خاطئة أو مضللة، مما قد يعرض المستخدمين للخطر، خاصة في القضايا الحساسة مثل السرطان أو وظائف الكبد.

س: هل جميع المعلومات التي تقدمها الأداة غير دقيقة؟

ج: لا، جوجل تؤكد أن الغالبية العظمى من الملخصات دقيقة وموثوقة، وأن الأداة تعمل باستمرار على تحسين الجودة.

س: ماذا يجب على المستخدم فعله عند استخدام الأداة؟

ج: يُنصح بالتحقق دائمًا من المعلومات واستشارة المختصين قبل اتخاذ أي قرارات صحية أو طبية.

س: هل ستتخذ جوجل أي إجراءات لتصحيح الأخطاء؟

ج: نعم، الشركة قالت إنها ستتخذ الإجراءات المناسبة وفق سياساتها إذا أساءت الأداة تفسير محتوى الويب أو أغفلت السياق.